Copyright 2018-2025 汽车星 版权所有 京ICP备2019162790号

开源炸场!Qwen3-Next 80B,每次仅激活约3B;训练成本约1/10,32K以上长文本吞吐提升约10倍,原生256K。这才是开源最想看的答案。

AI狂飙,闭源大模型坚信「越大越强」、「大就是好」。

但一只80B的开源「小钢炮」却给了另一个答案:Qwen3-Next。

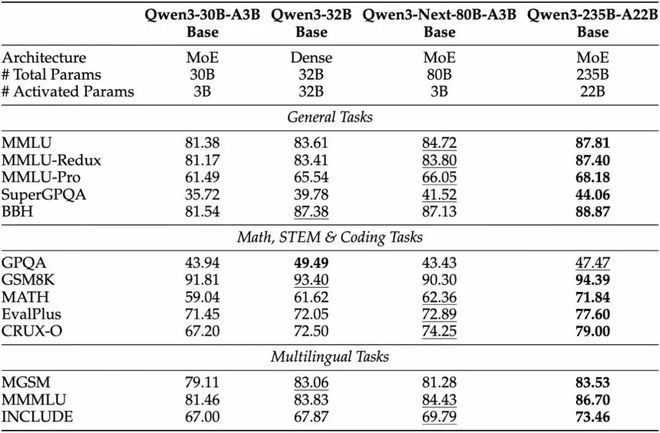

它用极稀疏MoE与混合注意力,把单次激活压到≈3B,训练成本约1/10、32K+长上下文、推理吞吐≈10×,在多项推理与长文场景逼近甚至反超闭源竞品。

小体量、低成本,却能硬刚巨头——这才是开源最想看的答案。

80B小体量,凭什么挑战235B巨头?

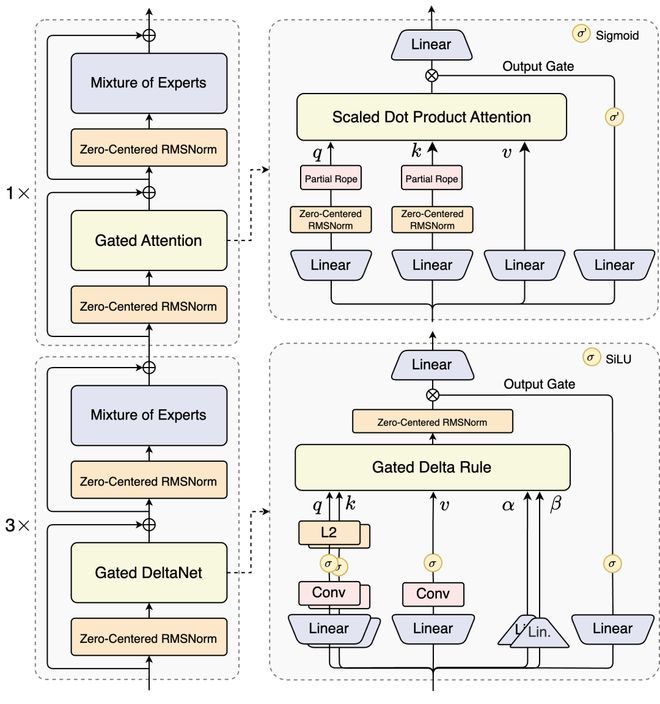

Qwen3-Next的混合架构。采用Gated DeltaNet+Gated Attention的混合注意力与高稀疏MoE,并通过zero-centered与weight-decayed LayerNorm等稳定化手段,提升大规模训练稳定性

极致稀疏MoE:512专家只激活3B

闭源大模型的常见逻辑是「越大越强」:参数从百亿到千亿一路狂飙,成本和门槛也被推到极高。

但Qwen3-Next给出了另一种答案——它只有80B总参数,却通过极致稀疏的MoE 架构,把「小体量」贯彻到了极致。

采用极稀疏MoE(1:50):512专家中每个token仅激活10个专家+1个共享专家,激活参数≈3B(约3.75%)

这种「按需激活」的设计,不仅让计算资源利用率最大化,也在官方评测中跑出了接近235B旗舰模型的表现。